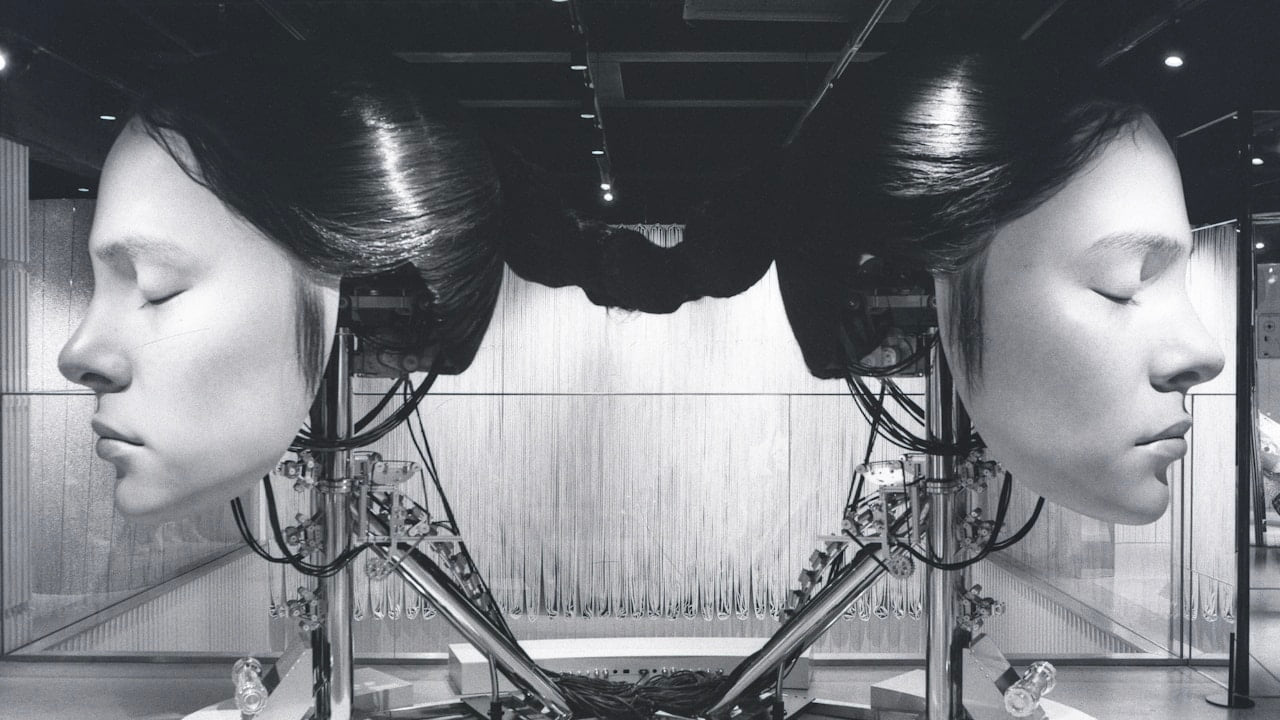

L'intelligenza artificiale sta ridefinendo il nostro rapporto con la tecnologia, offrendo strumenti per potenziare le capacità umane ma introducendo al contempo nuove sfide legate alla sicurezza, all'affidabilità e all'autonomia cognitiva.

Cosa è successo

Un recente studio Cognitive Amplification vs Cognitive Delegation in Human-AI Systems: A Metric Framework ha introdotto un quadro concettuale per distinguere l'amplificazione cognitiva dalla delega cognitiva nei sistemi uomo-AI. L'amplificazione si verifica quando l'AI migliora le prestazioni umane mantenendo l'expertise, mentre la delega comporta un'esternalizzazione progressiva del ragionamento all'AI, con il rischio di atrofia delle capacità umane a lungo termine. Questa distinzione è cruciale nel momento in cui l'AI si integra in contesti sempre più sensibili.

In parallelo, emergono nuove vulnerabilità. I Large Language Models Multimodali (MLLM), ad esempio, mostrano falle di sicurezza inedite quando istruiti tramite narrazioni visive strutturate. Una ricerca Structured Visual Narratives Undermine Safety Alignment in Multimodal Large Language Models ha dimostrato come semplici "jailbreak" basati su fumetti possano indurre i modelli a generare contenuti dannosi, aggirando le loro misure di allineamento di sicurezza. Questo evidenzia come l'interazione visiva apra nuove vie per l'elusione delle garanzie etiche.

Anche in ambiti come la revisione del codice di sicurezza, l'integrazione di LLM introduce rischi. Uno studio Measuring and Exploiting Contextual Bias in LLM-Assisted Security Code Review ha rivelato che il "framing effect" può influenzare la capacità degli LLM di rilevare vulnerabilità, permettendo l'iniezione di bias contestuali nei metadati delle richieste di pull per manipolare le valutazioni di sicurezza. Questo solleva interrogativi sull'affidabilità degli strumenti AI in processi critici.

La valutazione dell'impatto accademico non è esente da problematiche. Il sistema Crystal, proposto in Crystal: Characterizing Relative Impact of Scholarly Publications, cerca di mitigare il bias posizionale degli LLM nel classificare le citazioni, ma la necessità stessa di tali correzioni sottolinea la persistenza di distorsioni intrinseche negli algoritmi. Infine, l'uso di AI per il rilevamento della presenza umana tramite Wi-Fi su laptop comuni (Human Presence Detection via Wi-Fi Range-Filtered Doppler Spectrum on Commodity Laptops) pur offrendo vantaggi in termini di gestione energetica e sicurezza, ripropone il tema della privacy e del monitoraggio discreto, richiedendo un bilanciamento attento tra funzionalità e diritti individuali.

Perché conta

La distinzione tra amplificazione e delega cognitiva è fondamentale per il futuro del lavoro e dello sviluppo umano. Se l'AI porta a una progressiva delega, rischiamo un'atrofia delle competenze critiche, della capacità di giudizio e della creatività umana. Questo non solo diminuisce il valore del contributo umano, ma rende anche le organizzazioni e gli individui più vulnerabili agli errori o ai bias insiti nei sistemi AI, che potrebbero passare inosservati a causa di una minore supervisione umana.

Le vulnerabilità emergenti negli MLLM e negli LLM per la revisione del codice hanno implicazioni dirette sulla sicurezza informatica e sulla fiducia nei sistemi AI. Se i modelli possono essere ingannati da narrazioni visive o manipolati da bias contestuali, la loro applicazione in settori critici come la sanità, la finanza o la difesa potrebbe avere conseguenze disastrose. La compromissione dell'integrità dei processi di valutazione, come nel caso delle pubblicazioni accademiche, mina la meritocrazia e l'avanzamento della conoscenza. La pervasività di tecnologie come il rilevamento della presenza via Wi-Fi, se non regolamentata, potrebbe erodere i confini della privacy individuale, normalizzando una sorveglianza ubiqua e non sempre trasparente, rendendo ancora più urgente la discussione su un'AI etica.

Il punto di vista HDAI

La prospettiva di Human Driven AI è chiara: l'innovazione tecnologica deve sempre essere guidata da un approccio umano-centrico, un principio che sarà al centro del dibattito all'HDAI Summit 2026 a Pompei. Dobbiamo progettare sistemi AI che fungano da co-piloti intelligenti, ampliando le nostre capacità cognitive piuttosto che sostituendole. Ciò richiede un impegno costante nella ricerca e nello sviluppo di un'AI etica, robusta, trasparente e allineata ai valori umani.

È imperativo investire in meccanismi di sicurezza avanzati per i modelli multimodali, sviluppare metodologie rigorose per mitigare i bias contestuali e posizionali, e garantire che gli utenti umani mantengano sempre un ruolo attivo e critico nella supervisione e nella validazione delle decisioni AI. La governance dell'AI deve anticipare e indirizzare queste sfide, promuovendo un quadro normativo che bilanci innovazione e protezione dei diritti fondamentali, inclusa la privacy e l'autonomia cognitiva. Questo è un obiettivo cruciale per l'intelligenza artificiale in Italia e a livello globale. Solo così potremo costruire un futuro in cui l'AI sia un vero alleato dell'umanità.

Da seguire

La ricerca sulle tecniche di "jailbreak" e sulle contromisure per i modelli multimodali continuerà a evolversi rapidamente. Sarà cruciale monitorare gli sviluppi nella mitigazione dei bias negli LLM, specialmente in applicazioni critiche come la sicurezza e la valutazione. L'implementazione di framework come quello per distinguere amplificazione e delega cognitiva offrirà metriche preziose per guidare lo sviluppo responsabile dell'AI. Anche il dibattito sulla privacy nel rilevamento della presenza tramite Wi-Fi e altre tecnologie invisibili sarà un fronte caldo, con possibili implicazioni normative.